Deep faking : la falsification vidéo se développe à toute allure

Grâce à des logiciels simples d’utilisation, n’importe qui peut aujourd’hui intégrer la tête de son acteur favori dans une scène de film. Et peut-être bientôt celle de sa boulangère ou son boss.

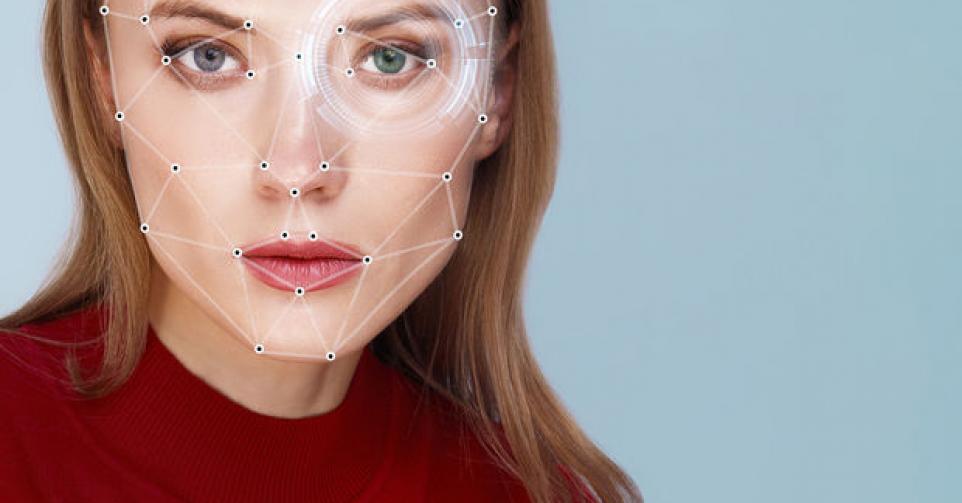

Le deep faking consiste à modifier un visage, des mouvements et expressions dans une vidéo. Il permet de faire dire à peu près n’importe quoi à n’importe qui, à différents degrés de réalisme. L’acteur et producteur Jordan Peele en faisait une démonstration de force en avril dernier, en postant sur BuzzFeed un discours de Barack Obama prononçant « Donald Trump est une grosse merde ».

Vous pouvez modifier vos choix à tout moment en cliquant sur « Paramètres des cookies » en bas du site.

Une autre technique, moins impressionnante, mais beaucoup plus répandue, consiste à plaquer l’ensemble d’un visage sur un autre. Nicolas Cage, par exemple, est ainsi devenu le chouchou des créateurs de mèmes.

Vous pouvez modifier vos choix à tout moment en cliquant sur « Paramètres des cookies » en bas du site.

Ces vidéos ont été réalisées avec l’application FakeApp, disponible en ligne. Une intelligence artificielle se charge de réaliser calculs et codages. L’opération est donc accessible à tous, même aux non-experts, du moment qu’ils disposent d’une large série de photos de la personne à intégrer. « Environ 10 000 clichés sont nécessaires pour réaliser un deep fake vraiment trompeur », précise Vincent Nozick, de l’Institut d’électronique et d’informatique Gaspard-Monge. Ce sont donc essentiellement des célébrités qui se retrouvent modifiées… pour l’instant.

Des personnes privées bientôt ciblées ?

La plupart des deep fakes en circulation sont encore détectables à l’oeil nu, les visages présentant des contours flous et des irrégularités. Mais la vitesse à laquelle se développe cette technologie inquiète les spécialistes. Bobby Chesney et Danielle Citron, auteurs d’une étude sur le sujet, ont repéré d’inquiétantes tentatives d’usage de cette technologie. Sur le forum Reddit, un participant demandait par exemple : « Je souhaite réaliser une vidéo porno de mon ex petite-amie. Je ne dispose pas de vidéo de haute-qualité, mais j’ai beaucoup de bonnes photos d’elle ».

« C’est déjà faisable », répond Vincent Nozick. « Avec le logiciel Face2face ». Celui-ci, mis au point par une équipe de l’université de Stanford, n’a besoin que de cinq minutes de vidéo pour créer un avatar fidèle. Heureusement pour la jeune femme citée plus haut, il n’est pas encore en libre accès. Le chercheur pense cependant qu’un tel outil ne tardera pas à être vendu, ou rendu public. « C’est le propre de toutes les innovations informatiques ».

La future utilisation des deep fakes dans le revenge porn semble encore plus évidente lorsque l’on sait d’où vient la pratique. Ce sont des internautes qui, les premiers, ont calqué les visages de stars féminines sur des actrices en pleine action. Et même si le fake porn est de moins en moins toléré par les hébergeurs (Pornhub a banni ces contenus, la page Reddit consacrée au partage de tutoriels a été supprimée), les contenus circulent toujours.

Comment détecter un deep fake

Parallèlement, les chercheurs ont engagé une course à la détection des falsifications. Des applications et des plugins proposent déjà d’analyser des captures d’écran de vidéos. Ils scannent le « bruit » de l’image, soit le nombre d’erreurs que renvoient les pixels modifiés.

« Le problème de ces détecteurs est qu’ils fonctionnent souvent en théorie, mais pas en pratique. Ils trouvent des erreurs quand le deep fake n’a été fait qu’à partir d’un seul outil, alors qu’en général plusieurs sont utilisés. » Vincent Nozick travaille à la mise au point du capteur MesoNet, qui se base plutôt sur la corrélation entre les mouvements du visage analysé, comme la coordination yeux-bouche. « Notre taux de détection est excellent : 95 % pour FakeApp, 98 % pour Face2face. »

Mais dès qu’un capteur est rendu disponible en ligne, sa technologie est utilisée par les falsificateurs pour améliorer leur propre logiciel. Dans cette escalade d’innovations, un seul outil fera vraiment la différence : le sens critique des spectateurs.

Juliette Chable

Vous avez repéré une erreur ou disposez de plus d’infos? Signalez-le ici